Noch ein Aspekt der Kombination Objektiv/Sensor. Was passiert, wenn man gute Objektive an niedrig auflösende Sensoren schraubt oder schlechte Objektive an hochauflösende Sensoren? Was hat das für Auswirkungen auf die Datenqualität?

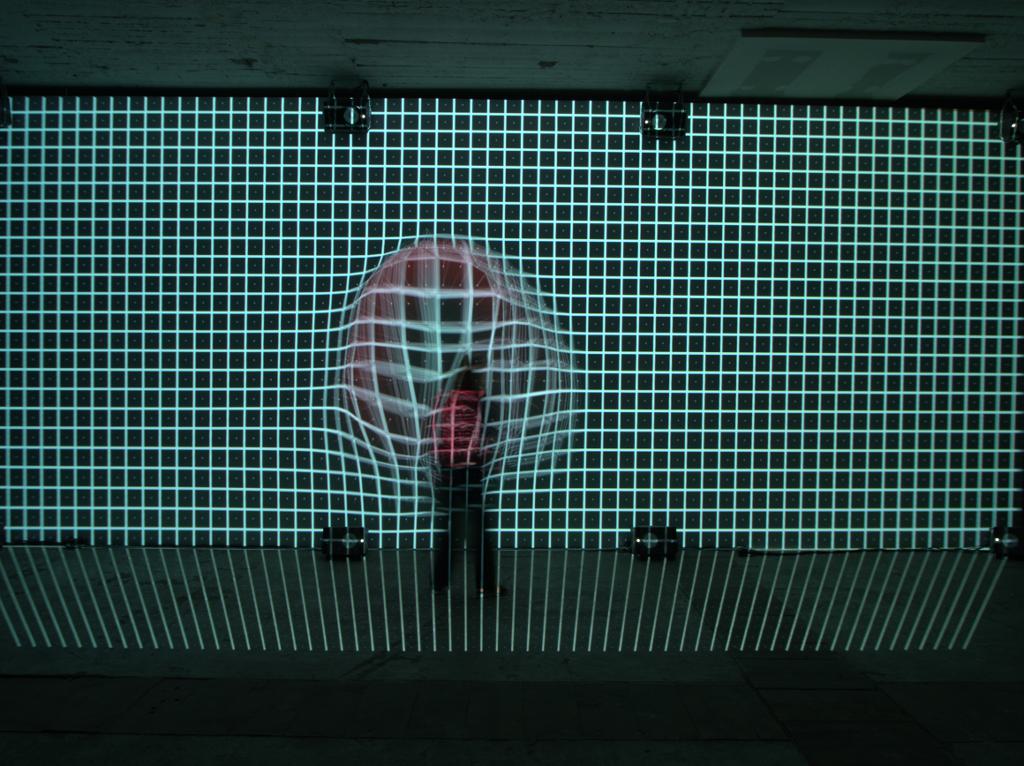

Hier haben wir einen Sensor, der viel höher auflöst, als das Objektiv. Punkte werden unscharf dargestellt.

Nun wird das Bild zweimal um 17° nach links gedreht, dann zweimal um 17° nach rechts. Die Sättigung geht etwas zurück, aber das Bild wird nicht wesentlich schlechter. Das Bild ist durch die höhere Auflösung gegen nachträgliche Manipulation vergleichsweise widerstandsfähig.

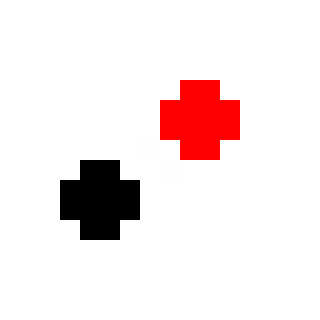

Hier haben wir einen Sensor geringer Auflösung und ein extrem scharf abbildendes Objektiv. Aus dem eigentlich vorhandenen „Punkt“ wird ein digitales „Kreuz“.

Gleiche Behandlung dieses Punktes: Das Bild ist gewaltig schlechter geworden. Die eigentlich weit auseinander liegenden Punkte überlappen sich bereits, das Bild wird matschig.

Soweit die Nummer also erst mal grafisch. Gerade beim Dias digitalisieren ist dieses Problem der mangelnden Datenqualität erheblich. Da scannt man mit phänomenalen 9600dpi und bekommt aber nur Daten für 2400dpi. Viel hilft viel. Um mal zu zeigen wie sowas aussieht:

XXVXXXOXXXGXXXEXXXLX

Hier haben wir 75% Datenmüll und 25% Nutzdaten. Wie heißt das Wort? Und jetzt ersetzen wir die X durch Buchstaben, die im Alphabet um den Nutzbuchstaben herum sind, also keine „weißen Pixel“ sondern ähnlichfarbige Pixel

TUVWMNOPEFGHCDEFJKLM

Da noch die Nutzdaten auszufiltern ist schon ziemlich anspruchsvoll.

Und nun schärfen wir nach. Schärfe bedeutet Kantenkontrast. Das bedeutet, ich steigere den Kontrast an Farbübergängen. Leider kann man die Schärfe nicht zwischen die Nutzdaten packen, sondern die Schärfe überschreibt Nutzdaten. Das sieht dann so aus;

AUVAANOAZFGZZDEZZKLZ

Alles jenseits des N bekommt ein A als Kontrast, alles davor ein „Z“. Siehe da, der Vogel ist deutlich besser zu erkennen. Schärfen wir aber den „VOGEL“ nach, dann sieht das so aus: „AOAZLZ“.

Überraschung: Bilder mit mieser Datenqualität sind viel einfacher nachzubearbeiten als Bilder, die eigentlich bereits aus der Kamera perfekt sind. Sie können einfacher gedreht und geschärft werden, weil ganz viel der Bildmanipulation den Datenmüll betrifft. Schlechte Bilder können also durch Bildmanipulation in Grenzen verbessert werden – aber niemals so gut werden, wie Bilder, die gleich von Anfang an eine hohe Datenqualität aufweisen. Allerdings: je besser die Bilder von Haus aus, desto schlechter werden sie durch Manipulationen.

Der berühmte Parameter „Bildqualität“, der derzeit so gehypt wird – hier hat er seinen Ursprung. Leider wird heutzutage so viel bereits in der Kamera an den Bildern getrickst, dass die tatsächliche Bildqualität, die aus der Kamera kommt, bei vielen Sensor/Objektivkombinationen nur noch im Bereich YVDFOGKGHDEFHLK liegt. Da werden CAs entfernt, Beugungen rausgerechnet und Objektivverzerrungen korrigiert. Und natürlich nachgeschärft bis der Arzt kommt.

Hochauflösende Sensoren an Kitscherben oder 5MP an Repro-Glas? Wenn man Bock drauf hat, miese Bilder durch Bildverarbeitung aufzupeppen: Ersteres. Wenn man so fotografiert, dass man nach dem Auslösen fertig ist – Letzteres.

Die Bilder hat mir übrigens Excire zum Thema „Headroom“ rausgesucht. Headroom ist das was da außenrum um das Signal ist, das man manipulieren kann, ohne das Originalsignal zu zerstören.

Schön, dass ich den größeren Teil meiner Fotografie nach dem Auslösen als „fertig“ ansehe. Da komme ich dann mit den 16MPix der 1. E-M1 an den „ollen“ FT TopPros aus 😉

.

Den Puppenkopf im Karton als „Headroom“ anzusehen finde ich übrigens ziemlich kreativ und witzig! Von wegen KI könne nicht kreativ… *lol*

.

jm2c, Martin

Reinhard, vielen Dank für diese Ausführungen. Das war sehr interessant für mich zu lesen.

Gruß Lutz

Hmm, mit der scharfen Abbildung auf niedrig auflösendem Sensor komm ich nicht klar. Der Punkt, wenn er denn rund ist, hat auch in den Ecken Auswirkung auf die Pixel. Er trifft ja nicht nur die 5 Pixel des Kreuzes sondern das ganze Quadrat aus 9 Pixel. Die Ecken halt mit entsprechend geringerer Intensität. Nur halt deutlich gleichmäßiger ans beim Flaschenboden.

Du hast natürlich recht. Bei einem größeren runden Punkt müsste in den Ecken noch ein hellgraues Quadrat sein, Ist der Punkt kleiner, müssten die äußeren schwarzen Punkte heller sein. Aber dann wäre der Effekt nicht mehr so hübsch…. Denn prinzipiell könnte der Punkt ja auch kreuzförmig sein. Wenn es sich um einen digital gedruckten Punkt handelt, dann ist der sogar ziemlich sicher kreuzförmig.