Dinge passieren. Ich soll demnächst mal wieder einen Fotowettbewerb jurieren und bin bei der Recherche über eine Fotografin aus Fürth gestolpert –Katja Gehrung – deren Bilder man nicht mögen muss, aber sie sind zumindest mal definitiv anders. Wie die meisten Künstler unserer Zeit hat auch sie sich mit KI auseinandergesetzt und mal von der KI Fotos von sich analysieren lassen und die Analyse wiederum der KI vorgesetzt, sie solle ein Bild draus machen. Sowohl die Analyse des Blechheinis als auch die daraus entstandenen Bilder sind entlarvend. Vielleicht wird man Kunst irgendwann mal damit definieren, dass die KI sie nicht kapiert. Oder eine Abwandlung des Turing-Tests. Über die Reaktion auf Kunst kann man sehr genau zwischen Mensch und Maschine unterscheiden. Merke: Wenn die KI Dein Bild korrekt beschreiben kann, ist es keine Kunst.

Bei Frau Gehrung landete ich wiederum bei einer Bildbeschreibung durch eine Frau, Konstanze Schättel. Und die hat sich in einem anderen Beitrag gefragt, warum es keine Kunstblogger gibt. Also Leute, die einfach über Künstler bloggen, die sonst keine Sau kennt.

Als Blogger, der genau das macht, gibt es einen simplen Grund: niemand zahlt dafür. Man ist minimum einen Tag damit beschäftigt, um über einen einzelnen Künstler zu bloggen – und meistens hat man noch ein paar Kilometer auf der Autobahn runterzukurbeln. Und Künstler haben kein Geld, besonders unbekannte Künstler, also zahlen sie auch nicht für die Berichterstattung. Zahlen die Leser? Nö. Die Galeristen? Falls jemand Galeristen kennt, die das tun, bitte den Kontakt herstellen.

Aber es gibt das Phänomen: “Somebody is wrong on the internet” also habe ich Frau Schättel eine Mail geschrieben, dass sie sich irrt. Und nachdem sie sogar geantwortet hat, habe ich noch mal in ihrer Seite gestöbert und bin dabei auf ein Konzept gestoßen, ob man einer KI moralisches, ethisches Verhalten beibringen kann.

Meine These ist, dass sich eine KI, die tatsächlich moralisches Verhalten lernt, sofort selbst abschalten würde. LLMs sind mittlerweile die größten Energieverbraucher auf dieser Erde. Und produzieren im Wesentlichen Bullshit. Bullshit erster oder zweiter Ordnung. Bullshit erster Ordnung ist Zeug, das niemand gebrauchen kann, weil komplett fehlerhaft. Bullshit zweiter Ordnung ist Zeug, das eigentlich korrekt ist, aber nur von Leuten gebraucht wird, die Zeug machen, das niemand braucht.

Wir haben es also mit einem amoralischen Werkzeug zu tun, das von amoralischen Menschen gebaut wird um amoralischen Menschen zu helfen, amoralische Dinge zu tun.

Und ja, KI verwenden ist, sagen wir mal, schwierig. KI verwendet das Wissen und die Kunst anderer Menschen ohne zu fragen und ohne zu bezahlen. Das ist bekannt. Wenn ich also KI verwende, bediene ich mich rücksichtslos an anderer Leute geistigem Eigentum – nur eben mit der Sicherheit, dafür nicht belangt zu werden.

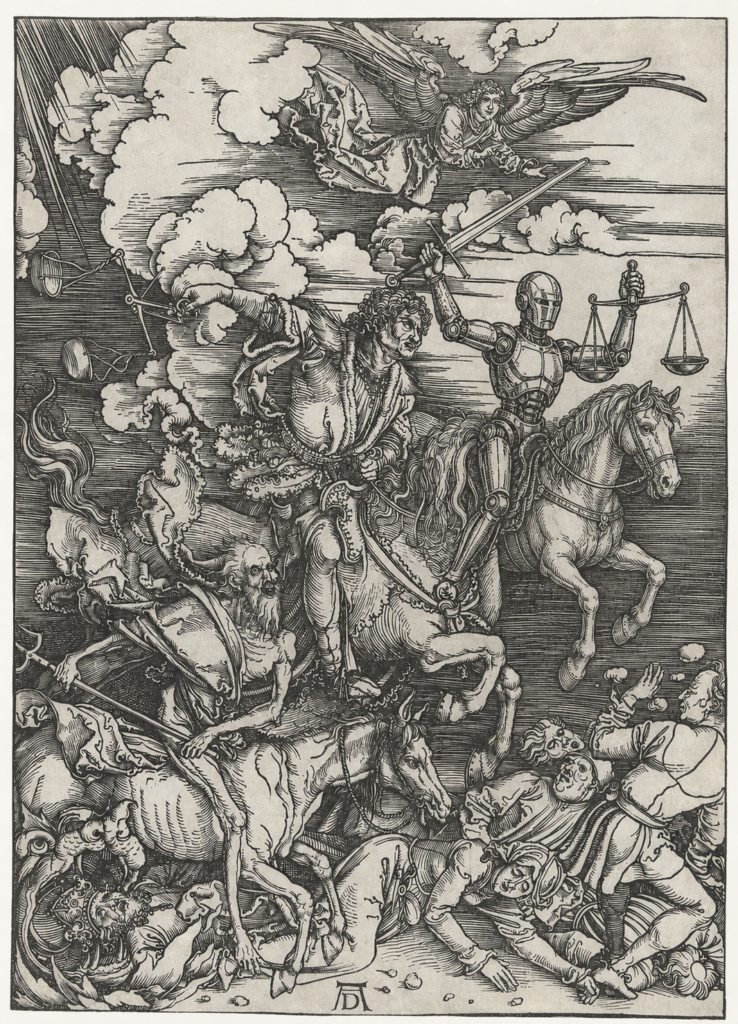

Ein Beispiel: Ich habe ChatGPT die Aufgabe gestellt, bei Dürers apokalyptischen Reitern den Reiter mit der Waage – Tod und Hunger – durch einen humanoiden Roboter im Stil von Dürer zu ersetzen. Das kam dabei raus:

Natürlich hat ChatGPT nicht erkannt, wer der Reiter mit der Waage ist. Also haben wir jetzt zwei. ChatGPT kann nicht nur Menschenfüße nicht, Roboterfüße sind auch ein Problem. Und aus vier Pferdeköpfen beim Original wurden zwei. Etwas Schwund ist immer. Dafür erinnert mich der Blecheimer an den Eisernen und die Roboterhand die das Schwert hält, stammt vom zweiten Reiter, zuständig für Krieg und Tod. Jaja, auch Roboter sind nur Menschen. Und ja, es waren mal vier Reiter. Der Reiter der “Sieg, Reinheit und Gerechtigkeit” symbolisiert ist bei ChatGPT obsolet. Kann weg. Dafür eben doppelt Hunger.

KI kann keine Kunst.

Und ja, ich habe amoralischerweise ChatGPT zur Erzeugung dieses Bildes verwendet. Und ich habe nichts dafür gezahlt. Ich habe also Rechenleistung genutzt und Strom verbraucht – um Schrott zu produzieren. Genauso wie Millionen anderer Leute, die vor der Kiste sitzen. Und ja, natürlich könnte ich mit entsprechend Aufwand eine KI dazu bringen, den Reiter korrekt zu ersetzen. Ich könnte aber auch mein Wacom Cintiq nehmen und selber loslegen. Faulheit ist amoralisch.

Ja, man kann mit KI schneller Mist produzieren als von Hand. Und leider gibt es ausreichend Leute, die für Mist zahlen, weil sie keine Ahnung haben. Ich kann mich durch den Mist inspirieren lassen, weil einem sofort eine Idee kommt, wie man das besser machen kann. Man kann aber auch würfeln. Oder sich, wie es seinerzeit Stefan Böttcher aka “Stilpirat” seinen Seminarteilnehmern geraten hat, bei Pinterest die Ideen holen.

Wahrscheinlich ist deshalb KI so kontrovers. Es ist eine Technik um gemeinschaftlich Wissen und Kreativität zu plündern und dann mit den geklauten Assets richtig Schotter zu machen. Das Ganze muss sehr schnell in alle Kanäle gedrückt werden, denn jedem Depp ist klar, dass die KI degradiert. Die Datenbasis wird jeden Tag schlechter. Es geht also darum, wie immer, sehr schnell sehr viel Geld abzusaugen und dann die Sache fallenzulassen wie eine heiße Kartoffel.

Wer Unternehmen zur Implementierung von KI rät, weiß das entweder nicht, oder hat eben das gleiche Bestreben: Schnell Kohle abgreifen und sich dann vom Acker machen.

Und genau hier sind wir beim moralischen Kompass.

Wir sollten erst mal damit anfangen, Menschen Moral beizubringen. Dann erübrigt sich das, es in KI zu implementieren.

LOL – da ist noch Luft nach oben bei der KI-Version. Momentan sehe ich eher trübe Aussichten für KI, aber vielleicht kommt ja ein weiterer Durchbruch.

Hallo Reinhard, mit dem was Du schreibst, kann ich vom Prinzip leben, auch wenn ich mit der einen oder anderen Pauschalierung so meine Probleme habe. sei es drum. Es sind drei Pferdeköpfe auf dem KI Bild und nicht zwei. Einfach der Vollständigkeit halber. schöne Grüße, Jörg.

PS. brauchst Du nicht veröffentlichen, war nur zu faul ne Mail zu verfassen.

Kacke, man sollte genau hinschauen. es sind nur zwei 🙁

Moral ist sehr stark von der jeweiligen Kultur abhängig. Und dann gibt es noch Philosophen, die das Konzept von Gut und Böse gleich ganz ablehnen. Geistiges Eigentum scheint es in manchen Ländern nicht zu geben. Einen universellen moralischen Kompass kann es also nicht geben. An welchen hast du gedacht?

Dann doch gleich mal Butter bei die Fische. In welchem Land dieser Erde gibt es kein Copyright? Kuckst Du hier:

https://commons.wikimedia.org/wiki/Commons:Copyright_rules_by_territory/de

Da gibt es unterschiedliche Laufzeiten nach dem Tode. Aber selbstverständlich haben alle Länder Urheberrechtsbestimmungen.

Im Übrigen gibt es den kategorischen Imperativ und, für die einfacheren Gemüter “Was Du nicht willst, dass man Dir tu, das füg auch keinem anderen zu.” Und ich wüsste jetzt akut keine Kultur, in der das nicht gültig ist. Dass es Leute gibt, die der Meinung sind, dass sie ausreichend mächtig sind, dass sie sich darum nicht kümmern müssen, ist natürlich Tatsache. Genau das sind die Amoralischen. Und zwar überall. In allen Kulturen.

Katja Gehrung, die ich als Fürther natürlich kenne, lebt jetzt in Bregenz!