Ja, das ist ein Stiefmütterchen und keine lila Kuh. Aber es ist eines der schönsten Bilder, die ich habe, zum Thema „Lila Problem“. Ein anderes Foto, auch schon uralt, ist dieses hier:

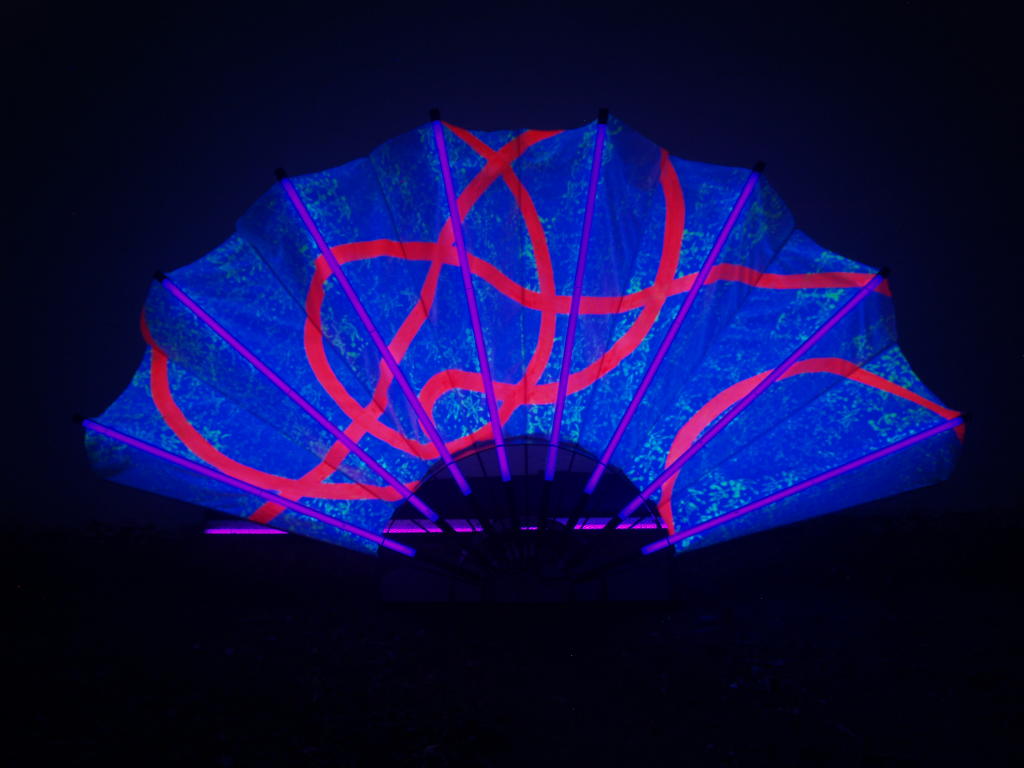

Das ist von der „Berchinale 2006“. Mit der E-500. Und damals war ich irgendwie schwer verzweifelt, weil dieser Fächer eben keinesfalls knallblau aussah, sondern lila. Ich habe das dann immer wieder versucht und irgendwann mal Nils gefragt, was da los sei. Antwort: Die Kameras können das lila nicht. Das sei nicht in der Farbpalette drin und da habe es auch schon Fotografen gegebn, die für Milka die Lila Kuh fotografieren wollten und das ging nicht.

OK. Die letzte Story halte ich für eine Urban Legend. Aber das Lila-Problem hat mich verfolgt. Ich habe lange bei jeder neuen Kamera Stiefmütterchen fotografiert und das Problem immer und immer wieder aufgewärmt, bis ich entweder keine Stiefmüttterchen mehr gefunden habe oder Olympus die Farbpalette erweitert hat.

Nun habe ich mal wieder meine Schwarzlichtlampe ausgepackt um die OM-5II drauf loszulassen.

Das Blau passt nicht und das lila der Röhre passt auch nicht. Auch mit einer Änderung von Weißabgleich und/oder Belichtung funktioniert das nicht.

Dann habe ich meine alte E-500 abgestaubt, das gleiche Objektiv dran, gleicher Weißabgleich und „gib ihm“.

Man sieht, der Kontrastumfang der E-500 ist sehr deutlich schlechter. Das Bild ist etwa knapper belichtet als das der OM-5II, aber trotzdem ist das Weiß des Kittels großflächig ausgefressen. Der Sensor der OM-5II ist ja nun auch schon ein Jahrzehnt alt. Kann das die OM-1 besser?

Ich würde sagen, deutlich das beste Bild von der Zeichnung her. Aber die Farbe stimmt trotzdem nicht.

Das nahe UV und die durch das UV angeregte Luminiszenz ist wohl immer noch ein heftiges Problem. Kurze Frage an die Community, die Kameras anderer Hersteller verwenden: Klappt das bei euch?

Ach ja: das Stiefmütterchen war natürlich lila. Und nicht blau.

Ich habe leider keine Antwort darauf, aber eine weitere Frage:

Stimmt es, dass man ein ähnliches Problem mit der Farbe hat,

die bei (polierten) Goldoberflächen entsteht?

Oder anders gefragt:

Kann man Gold fotografisch korrekt aufzeichnen/wiedergeben?

Das ist die Frage, welche Ansprüche man stellt und was dabei rauskommen soll.

https://www.spektrum.de/lexikon/physik/metalloptik/9662

Die Frage ist, welches Medium soll das Bild hintennach wiedergeben und welche Beschränkungen hat das. Wenn man ein Medium hat, das kein nahes UV abstrahlt/reflektiert, wird das etwas schwieriger. Und Gold sieht halt auch unter Kunstlicht anders aus als unter Knallsonne. Was ist nun „korrekt“?

Ganz eindeutiges Jein!

Gold, das glänzt, wirst du nie „richtig“ fotografieren können, weil es halt spiegelt. Da hast du dann deine Lichtquellen, ggf. deine Kamera und dich selbst, etc. mit drin. Und kaum jemand von uns hat einen komplett neutralgrauen Raum…

Nicht umsonst werden für die entsprechende Werbung schon lange Bilder sehr aufwendig retouschiert oder gleich komplett gerendert (auch schon lange vor der sog. „KI“), wenn die Oberflächen der Produkte (von Bierflasche bis Sportwagen) irgendwie spiegeln.

Auch eher mattes Gold sieht auf Fotos anders aus, als wir es mit dem Auge sehen.

Ich habe die Ehre, alle Bilder einer Künstlerin zu fotografieren, bevor sie ausgeliefert werden. Da sind auch großformatige Bilder mit Neon-Farben und/oder Blattgold dabei.

httpx://www.wibkealbrecht.com/gallery

Beides, Neon und Gold, lässt sich fotografisch nicht so einfangen, wie wir es sehen.

Unsere Sensoren nehmen nur R(ot), G(rün) und B(lau) auf und unsere Wiedergabegeräte geben nur R, G und B wieder. Sämtliche Farben, die wir sehen, werden dann aus diesen drei Farben gemischt. Das funktioniert relativ gut, wenn wir uns auf ein relativ enges Farbspektrum begrenzen. sRGB (und auch AdobeRGB, wie auch alle anderen) blenden aber Farben aus, die wir noch sehen können.

Jetzt aber erst einmal das Lila-Problem, dass alle Kameras mehr oder weniger haben…

Die Farbfilter der Kameras haben ihre Maxima der Farbkurven grob bei 600nm (R), 530nm (G) und 460nm (B).

Das Lila des Logos der Firma mit der Kuh wird im RGB (Photoshop) zusammengebaut aus 126/105/172. Mein Monitor baut also aus relativ viel Blau, ordentlich Rot und ein wenig Grün die Farbe, die wir alle sofort mit den entsprechenden Süßigkeiten assoziieren. Funktioniert. Für einen Druck im CMYK-Farbraum wäre das übrigens 60/63/0/0. Ich mische für den Druck also Cyan und Magenta zu fast geichen Teilen und lasse Gelb und schwarz komplett weg.

Nun nehme ich die Logo-Farbe, lasse sie meinen CMYK-Tintenpisser einmal auf handelsübliches Papier ausdrucken, mache mit der Kamera einen Weißabgleich (in der Sonne) auf ein leeres Blatt Papier und fotografieren dann das ausgedruckte Lila. Schon der Ausdruck sieht etwas anders aus als das Lila auf dem Bildschirm. Und das Foto des Ausdrucks sieht auf dem Schirm natürlich noch einmal anders aus. Aber so grundsätzlich stimmt die Farbe. Und auch die RGB-Werte des Fotos des Ausdrucks der Logo-Farbe entsprechen so in etwa denen des Originals. Trotz zweifacher Farbraumwandlung (RGB in CMYK und wieder in RGB) und den Unzulänglichkeiten vom billigen Drucker, Tinte, Papier sowie der „freien Interpretation“ des Weißabgleiches der Kamera.

Kein Wunder! Denn ich habe das Lila aus R, G und B komponiert. Das kann ich natürlich auch mit einer RGB-Kamera aufnehmen.

Lila in der Natur ist aber eine eigene Farbe!

Natürliches Lila, als eigenständige Farbe, hat Wellenlängen, die unterhalb von ca. 430nm überhaupt erst anfangen. Gäbe es eine Lila Kuh tatsächlich in der Natur, z.B. weil sie ausschließlich die Blütenblätter der lila Stiefmütterchen frisst, dann hätte ihre Farbe eine Wellenlänge um die 400nm.

Welche Pixel unserer Kameras springen darauf an?

Genau: Ausschließlich die B-Pixel! G und R reagieren bestenfalls im einstelligen Prozentbereich. D.h. das Lila der Steifmütterchen-Kuh sieht für unsere Kameras genau so aus, wie das Blau der weltbekannten Handcreme!

Wenn faktisch nur die B-Pixel Signal liefern kann unsere Kamera nicht mehr unterscheiden, ob das Licht nun 430nm, 400nm oder noch darunter hat. Wie auch?!?

Tatsächlich liefern auch die R- und G-Pixel „da unten“ noch ein ganz klein wenig Signal, so dass Stiefmütterchen-Kuh und Handcreme schon minimal unterschiedlich aussehen, aber Lila eben nicht mehr realistisch lila.

Neon-Farben liefern jetzt tatsächlich sogar etwas UV-Licht. Also Wellenlängen, die noch kürzer sind als lila/violett. Das können unsere Kameras gar nicht aufnehmen. Üblicherweise haben die Sensoren einen UV-Sperrfilter. Und analog haben wir früher einen UV-Filter vor unsere Objektive geschraubt. Damit Licht mit starkem UV-Anteil (den wir irgendwann auch nicht mehr sehen), z.B. Sonnenlicht, insbesondere in Höhenlagen, nicht unseren Film bzw. unsere Blau-Pixel überbelichtet.

Reflektierende bzw. glänzende Oberflächen, womit wir wieder beim Gold wären, reflektieren nun ggf. auch Licht, welches unsere RGB-Sensoren nicht oder nicht richtig aufnehmen können (von der Wiedergabe der Monitore ganz zu schweigen). Also sowohl UV- als auch IR-Licht, wenn die Lichtquelle diese abgibt. Unser Auge kann da mehr aufnehmen und richtig zuordnen, als die RGB-Sensoren (mit zusätzlichen UV- und IR-Sperrfilter). Deshalb wird Gold auf einem Foto immer anders aussehen, als direkt mit den Auge betrachtet (auch mattes Gold).

Gedruckt sieht es noch weniger nach Gold aus. Gold als einheitliche Fläche hätte in etwa die RGB-Werte von Ocker. Und so sieht es gedruckt auch aus.

Bei den Bildern von Wibke Albrecht haben wir bewusst mit Streiflicht gearbeitet um die Struktur des Blattgoldes zu betonen. Dadurch und durch einen bewusst beibehaltenen Helligkeitsverlauf „ahnt“ man das Gold dann doch recht gut.

Gold ist sehr schwer zu fotografieren. Deshalb hat mir mein Freund Achim auch mal geschrieben: „Deshalb hat Rembrandt seinen „Mann mit Goldhelm“ wohl auch gemalt und nicht fotografiert ;-))“

jm2c,

Martin

Mal zur Veranschaulichung eine Grafik:

https://www.tucsen.com/uploads/Example-of-a-typical-color-camera-quantum-efficiency-curve.png

Sie zeigt ein „Beispiel einer typischen Quanteneffizienzkurve einer Farbkamera“.

Der Mensch kann ab ca. 360nm Wellenlänge aufwärts sehen. Bis ca. 425nm definieren wir dies als „violett“.

Bei 425nm haben die blauen Pixel des (Bayer-) Sensors schon 4/5 ihrer maximalen Empfindlichkeit, während Rot und Grün eher unterhalb von einem Zehntel ihrer maximalen Empfindlichkeit liegen.

Von 425nm abwärts, also unserem „Lila“, stürzt Blau massiv ab und Rot und Grün zappeln auf niedrigem Niveau wild rum. Von 380 -> 360nm, dem wirklich satten „Lila“, stürzen alle drei massiv ab (und das leider auch noch unterschiedlich)…

Dass unter diesen Voraussetzungen die Software riesige Schwierigkeiten hat, ein vernüftiges Signal zu erkennen UND daraus eine realistische Farbreproduktion zu berechnen sollte jeder/m einleuchten.

Das Problem der Kurve ist, dass sie zwar „typisch“ ist, aber eben nicht real. Die realen Kurven hängen vom Design der Farbfilter und der Bandpässe ab.

Eben!

Deshalb sind die unterschiedlichen Kameras mit unterschiedlichen Sensoren auch unterschiedlich in der Aufnahme von „Lila“.

🙂

„Jetzt aber erst einmal das Lila-Problem, dass alle Kameras mehr oder weniger haben…

Die Farbfilter der Kameras haben ihre Maxima der Farbkurven grob bei 600nm (R), 530nm (G) und 460nm (B).“

Genau das ist das Problem: Die Farbwahrnehmung des menschlichen Auges unterscheidet sich deutlich von der des Sensors, die Empfindlichkeitsmaxima unserer Augen befinden sich bei 564nm (R), 534nm (G) und 420nm (B) https://de.wikipedia.org/wiki/Farbwahrnehmung, wobei alle drei Zapfen auch noch UV-Empfindlich sind. Je nachdem wie scharf die Farbfilter des Sensors das UV-Licht abschneiden wird UV-Licht anders wiedergegeben als wir es wahrnehmen. Das ist eine grundsätzliche Limitierung des Kamerasensors, da sich die Transmissionskurven der Filter nicht beliebig wählen lassen. Auf der anderen Seite differenziert der Kamerasensor Rottöne besser, als wir das können. Einen Vorteil hat die UV-Blindheit des Sensors: Das Fehlen des UV-Anteils erleichtert die Farbkorrektur des Objektivs. Man kommt nicht umhin, in einigen Fällen Farbanpassungen in der EBV vorzunehmen. Oder eben akzeptieren, dass der Sensor manche Blüten stiefmütterlich behandelt.

Meiner Erfahrung nach ist Olympus (zu OM-Kameras kann ich nichts sagen) in dieser Hinsicht deutlich besser als Fujifilm. Mit meinen Fuji-Kameras werden violette Blüten fast farblos grau. Bei Olympus haben sie zumindest eine Farbe, die so einigermaßen hinkommt.

Gegenüber ist eine Gärtnerei, die nun alle möglichen Stiefmütterchenvarianten anbietet. Sie sind draussen unter einem weissen Dach. Heute war perfektes Licht. Die Messung hat 5547 K ergeben. Bedeckter Himmel mit einer warmweissen Wolke, also schön diffus und gut für leuchtende Farben.

Weil ich selber zu Lila nachforschen wollte, bin ich in die Gärtnerei für Testaufnahmen. Trotz optimaler Bedingungen waren die Fotos der Stiefmütterchen nicht genau in der Farbe. Ich musste die K höher stellen, dann wurden die blauen und violetten erstaunlich gut wiedergegeben. Reinhard hat wohl auch mit den Kelvin probiert, denn die Grüntöne im Aufmacherfoto sind recht kalt. Die ganz dunklen Blüten in einem warmem Rot waren am schwierigsten. Sie wurden zu gelb und zu leuchtend. Blätter haben nicht mehr gleich gut gestimmt wie die Blüten. Vielleicht machen 16 bit und eine sehr grosse Dynamik den Unterschied (X2D).

Mit der Oly ist es mir nicht gelungen. Mit allen hochgesättigten Farben gab es Probleme. Leuchtendes Gelb übersteuerte oder wurde schmutzig bei minus-Korrektur. Violett wurde blau.

Wenn ich frühere Blütenfotos aus der Oly drucken wollte, bin ich gut gefahren, die Sättigung von knalligem Violett und Magenta zu reduzieren. Der Knalleffekt war zwar dahin, aber die Farben wirkten besser. Wenn man die Sättigung in anderen Bereichen optimiert, fällt der Trick nicht auf. Botaniker mal ausgenommen.

Die Kuh wurde lila, weil man damals die Idee mit der farbigen Kuh nicht ganz ernst genommen hatte und deshalb nur eine einzige Farbe zur Hand hatte. Nachträglich wurde dann erklärt, dass Lila genau gewollt wäre. Die Farbe war natürlich nicht so satt und leuchtend wie die Blüten. Das schwierigste war die Kuh, denn ein Atelier war neu für sie. Sie tat, was Kühe bei Nervosität noch mehr tun: Jedesmal musste der weisse Untergrund ersetzt und die Kuh hinten neu angemalt werden. Deshalb dauerte die Fotosession bis tief in die Nacht. Die analoge Hasselblad hatte anscheinend keine Probleme mit Lila.

Diese Geschichte hat mir der Grafiker/Fotograf erzählt, der das Ganze durchgeführt hat und den ich zufälligerweise kennen lernen durfte.

„Die analoge Hasselblad hatte anscheinend keine Probleme mit Lila.“

.

Klar!

Das liegt nicht an der Kamera(marke), sondern am Aufnahmemedium.

Analoge Filme sind/waren halt nicht „fast blind“ für Lila, wie es digitale Sensoren systembedingt sind.

Es gab mal ein plug-in, von dem behauptet wurde, dass es das Lila wiederherstellen könne. Ich habe es auch gerne verwendet. Den Namen habe ich vergessen. Das gibt es schon lange nicht mehr, ich glaube, es ist nun in radiant photo integriert.