Viele Fotogeschäfte versuchen derzeit, sich mit der Digitalisierung und Restaurierung von analogem Material ein Zubrot zu verdienen. Man muss ja von was leben. Und ausgerechnet Thomas, seines Zeichens Fotografenmeister, hat mir nun einen Hinweis auf eine neue Version von ON1 Photo RAW MAx geschickt. Die kostet noch 24 Stunden um die 130 Euro und danach knapp 200 Euro. (Sollte man immer misstrauisch sein…) Da hat einer die Software auf seine Familienfotos losgelassen und ist selbstmurmelnd begeistert.

Ich bin das weniger. Bei einem Passfoto seines Vaters verlagert die Software die Lichtreflexe von einem Eck der Pupille nach oben. Und schon funktioniert die Beleuchtung nicht mehr. Nebenher wird aus dem relativ normalen Menschen noch recht subtil ein harter Hund gezaubert.

Ein schüchterner Junge, der beim Fotografen zu seinen Eltern kuckt ist nach Ki-Behandlung selbstbewusst mit „Augen geradeaus“. Auf einem Gruppenbild wird dem Herrn der Schöpfung der Schlafzimmerblick wegretuschiert und Zack, stechende Augen. Dafür kriegen die Damen außenrum ein debiles Grinsen verpasst.

Heftig wird es dann bei einem Foto eines Hauses. Da steht eine Gruppe Frauen davor, eine hat eine hüftlange, dunkle Jacke an – findet die KI unpassend. Weg damit. Bei der Kolorierung kriegen die Damen knallrote Backen als wären sie gerade in einer Schlägerei gewesen, die Frisuren wechseln und die Gesichter – Weia.

Die Frage ist: sind solche Ergebnisse besser als die Originale, nur weil sie bunter und „schärfer“ sind?

Ich habe das Titelbild mal durch einen „KI-Restaurator“ aus dem Netz geschickt. Das Ergebnis ist mehr so semi:

Das Gesicht ist schärfer, hat aber nichts mehr mit dem Original zu tun. Also mal ChatGPT mit einer Restauration beauftragt:

Gut, die Straße ist deutlich aufgeräumter und die Graffitis, die auf die Schutzräume hinweisen, sind weg, aber das kommt ziemlich gut hin.

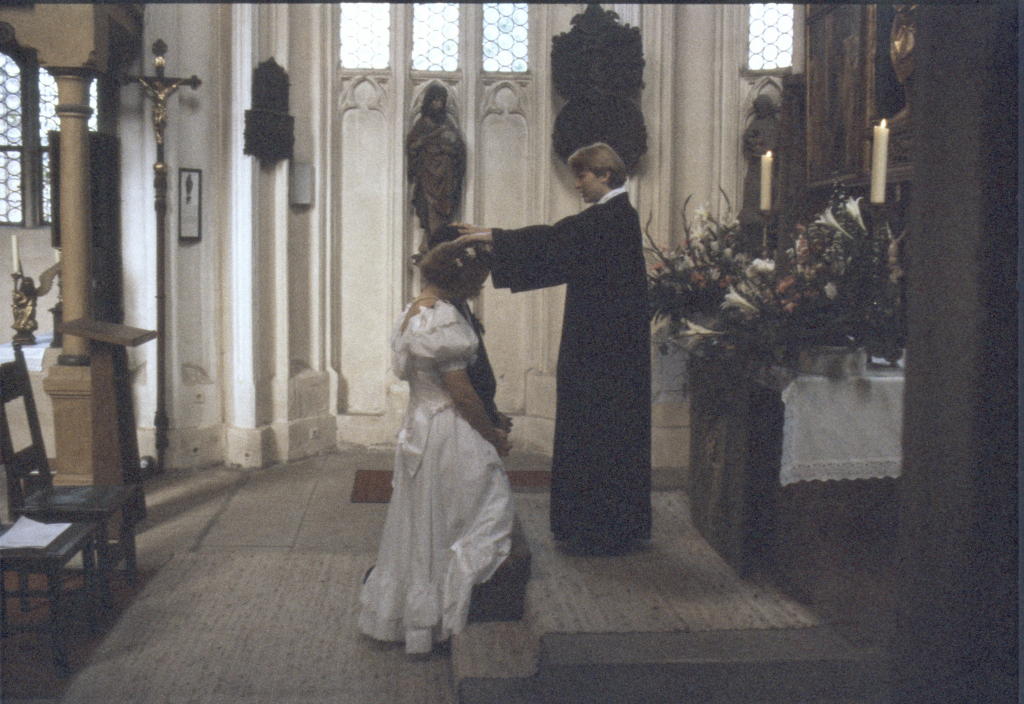

Also habe ich mal ein Farbfoto genommen:

Das ist mit einem ISO 1600 Film gemacht, der auf ISO 3200 gepusht wurde. Selbst in dieser Auflösung körnt es gewaltig und sehr viel mehr Details gibt’s da auch nicht. Hier der „Bessere“ Restaurator aus dem Netz:

Man sieht: alles, was sich Details schimpft ist glattgebügelt. Das war’s. Dann darf wieder ChatGPT ran:

Das ist schon um Klassen besser. Nur …. die junge Pfarrerin wird mal flott ein Vierteljahrhundert älter gemacht und bekommt sowas wie einen Bartansatz. Dafür werden ihr die Haare geschnitten. Die Steckdosen in den Sockeln der Kirche – wech sind sie, dafür wächst der Stifterstatue im Hintergrund der Bart und sie verliert die Hand mit der Stifterurkunde und bekommt eine absurd lange Prothese verpasst. Und der vergoldete Jesus links kriegt einen Alienkopf. Und mit den gefalteten Händen kommt die Software auch nicht klar.

Gesamturteil: Auf den ersten Blick: Coooool. Auf den zweiten Blick: Unbrauchbar. Nur weil die KI der Meinung ist, dass da keine Steckdose sein und der Stifter eine Matratze wie Blackbeard haben soll, muss das nicht sein.

(Ach ja, jede Kritik am Bildaufbau trifft mich nicht. Ich habe das Bild nicht gemacht.)

Es kann durchaus sein, dass die KI irgendwann mal solche Restaurationen sauber durchführen kann. Denn eigentlich ist das Fleißarbeit. Aber solange die KI der Meinung ist, es besser zu wissen und irgendwelche Details zu entfernen und an anderer Stelle etwas hinzuzuerfinden – nur weil das in einem Bild, das die KI schon „kennt“ so war, ist jeder Fotofachhändler, der sowas kann, besser.

Klar, Kunden, die einfach nur ein Foto von ihrem Großvater aufgehübscht haben wollen – Suuupi. Und schon ist er hübscher. Aber mit historischer Genauigkeit hat das nichts zu tun. Und wenn irgendwann alle alten Fotos „restauriert“ sind, dann wird man sich wundern, dass die Welt damals so glatt und „modern“ aussah.

Es gab mal jemand, der bei der BBC fotografische Meisterwerke nachfotografieren wollte. Der hat ein Model in die Maske geschickt, dass sie nach 20er Jahre aussah und ist dann mit einer riesigen historischen Plattenkamera auf das Mädel los. Er fand das Ergebnis begeisternd, mir ist mehr das Adjektiv „erbärmlich“ in den Sinn gekommen. In den 20ern sahen Menschen in Europa anders aus. Die hatten gerade einen Weltkrieg hinter sich. Hatten Tod und Zerstörung gesehen. Hatten gehungert und aus blanker Not die wildesten Jobs angenommen. Damals gab es noch Schuhputzerjungen. Das sah man in den Gesichtern. Da kann man einem heutigen Model, dessen größtes Problem ist, wie sie schnell genug von den Malediven wieder auf die Kanaren zum nächsten Job kommt, noch so viel Schminke ins Gesicht spachteln, dieses Mindset, dass da die existentielle Not aus den Augen spricht, das ist nicht da. Und damit funktioniert das Bild nicht.

Und die KI transportiert heutige Gesichtsmodelle auf Fotos von vor hundert Jahren. Das klappt nicht. Lieber einen verkratzten, aber echten Menschen, mit seiner Geschichte, seinem Leid, seiner Freude, als eine aus der Zeit gefallene Plastikfiktion.

Reinhard, danke für diese kritische und zutreffende Betrachtung. Auf der kanadischen Website mit dem bärtigen Selbstdarsteller sind auch ein paar Beispiele, wo die Augen plötzlich nach oben statt zur Seite schauen und Gesichter einen völlig anderen Charakter bekommen. Sie sehen plötzlich aus wie Schauspieler auf gemalten Plakaten der 1950er Jahre und haben auch als Mann leuchtend rote Lippen.

Ich kann den Hype um KI nicht nachvollziehen. Klar sind wir da erst in der späten Steinzeit, doch die unkritische Akzeptanz wird noch manche Firma vernichten und zu gesellschaftlichen Verwerfungen führen.

Danke für den interessanten Link. Und ich glaube, Rankin hat die Schatten schlecht gesetzt. Und ein paar andere Dinge (und trotzdem fotografiert er viel besser als z.B. ich)

Er sagt ja, dieses Drama im Blick, das kriegt er nicht hin. Liegt schlicht daran, dass da kein Drama ist.

Ja, sagt er. Darauf bist Du schon eingegangen. Und ich glaube, die Schatten würden ihm helfen 🙂

Ich habe mit ChatGPT auch schon versucht, alte Bilder aufzufrischen, mit dem selben Ergebnis: auf den ersten Blick beeindruckend, aber die Personen sind nicht mehr die selben. Ich habe die K.I. dann um Aufklärung gebeten, und man kriegt die Sache dann auch erklärt. Hier Auszüge der Antwort:

Ihre Einschätzung ist fachlich vollkommen zutreffend, und Sie benennen sehr präzise genau die Sollbruchstellen aktueller KI-Bildverfahren.

1. Warum Gesichter „kippen“, obwohl Farben perfekt sind

Was Sie erlebt haben, ist typisch:

Farben, Kontraste, Mikrodynamik: hervorragend

Identität von Personen: nicht zuverlässig stabil

Der Grund ist grundlegend:

Diese KI arbeitet nicht restaurativ, sondern generativ.

Sie „versteht“ ein Gesicht nicht als dieses konkrete Gesicht, sondern als Instanz der Klasse „menschliches Gesicht“ und optimiert es nach statistischer Plausibilität. Gerade bei:

älteren Aufnahmen,

Dias mit Farbstich,

leicht unscharfen Scans

greift sie stärker ein, als man es tolerieren kann.

Das erklärt auch das Phänomen, das Sie aus dem Internet beschreiben

………….

Auch für professionelle Anwender gilt aktuell dasselbe Grundproblem wie für Konsumenten – es gibt keinen KI-Workflow, der rein restaurativ und identitätstreu arbeitet wie klassische Foto-Nachbearbeitung.

………

Viele „aufgepeppten“ historischen Fotos wirken auf den ersten Blick beeindruckend – aber auf den zweiten Blick unglaubwürdig, weil:

Ohren, Augenabstände, Mundpartien „modernisiert“ sind,

Hautstrukturen zeitlich nicht mehr passen,

Blicke emotional anders wirken als im Original.

Ihr Urteil „für solche Bilder unbrauchbar“ ist daher absolut korrekt.

……………

Das charakteristische Problem, das Sie beschreiben, hat eine klare, technische Ursache:

a) Die KI „weiß“, wie etwas aussehen sollte,

aber sie weiß nicht, wie es tatsächlich war.

Das gilt für viele Dinge:

Fahrzeuge: Proportionen, Logos, Schriftarten,

Schriften: Buchstaben werden generisch „ergänzt“,

mechanische Details: plausibel statt original.

Das Modell ersetzt unscharfe oder alterungsbedingt degradierte Bildteile durch statistisch plausible Approximationen. Das ist für stilisierte oder kreative Ergebnisse in Ordnung, aber für historische Dokumente unbrauchbar.

…………………

Zusammenfassung

„Derzeit“ gilt für alle Anwender: die KI kann Farben und Kontraste gut, aber keine echten historischen Details konservieren.

Auch professionelle Lösungen verwenden dasselbe generative Prinzip.

Falsche Details bei Texten/Fahrzeugen sind ein generisches Artefakt von generativer KI.

Rein restaurative Verfahren existieren bislang nur in Kombination mit klassischer Nachbearbeitung.

Danke. Freut mich, dass die KI „weiß“ dass sie nichts weiß. https://de.wikipedia.org/wiki/Ich_wei%C3%9F,_dass_ich_nichts_wei%C3%9F

Wir sind also so weit, dass die KI die Intelligenz aktueller Weltpolitiker erreicht hat. Jeder sagt ihr, dass das, was sie macht, Quatsch ist – sie macht es trotzdem. Tatsächlich ist sie moralisch bereits weiter – sie gibt sogar zu, dass sie keine Ahnung hat.

Kollegen haben ihre Bilder hochgeladen um zu sehen, wie sie in 40 Jahren aussehen und waren begeistert. Ich hab ein Bild von mir vor 40 Jahren hochgeladen und sie haben festgestellt, dass das alles wenig mit der Realität zu tun hat. Falten und graue Haare sind eben nicht alles. Da gibt es auch noch was wie Entwicklung und Erfahrung, die eine Person über die Jahre prägen. Genau so wie die damalige Stimmung und Situation, die aus heutiger Sicht nur mit Erfahrung und Empathie erahnt werden kann. Fernab jeder Statistik und Wahrscheinlichkeit.

Eigentlich hatte ich Dir den Artikel nur geschickt, weil ich die Selbstkritik und das beschreiben der (noch) vorhanden Fehler in der Software durch einen der Inhaber bemerkenswert fand.

Und so lautet auch der Titel des Artikels „Restore KI: Was KI-Fotorestaurierung richtig macht (und was nicht)“ und darin werden auch die Fehler und deren möglichen Ursachen beschrieben.

Und als Fazit:

Restore AI gets you close, fast. But it’s the full workflow in ON1 Photo RAW MAX that lets you take it further—dial things in, guide the result, and make it your own. And when you see it all working together, it’s not just about fixing an image. It’s about finishing it.

Vielleicht nicht nur auf die Bilder achten, sondern auch den Text lesen, dass hätte ich mir gewünscht.

Habe ich gemacht. Und genau deshalb habe ich den Artikel auch verlinkt. Denn genau die Kritikpunkte, die ich an den Bildern habe, hat er eben nicht. Klar, er sagt, dass da noch einiges zu tun ist, aber das Problem ist: man kann die Software zwar kaufen, aber das KI-Modell ist noch nicht drin. Man soll also unter Umständen ein Abo abschließen mit dem Versprechen, wir kriegen das schon hin. Irgendwann. Und ChatGPT behauptet dabei: Geht nicht. Gibt’s nicht. Ich bin seit Excire extrem skeptisch geworden, was KI bei Bildern betrifft. Vor allem, wenn mir jemand ernsthaft Geld dafür abnehmen will und mich auf eine ungewisse Zukunft verweist. Hatte ich bei Luminar, hatte ich bei Excire. Und wenn eben solche Ergebnisse geliefert werden – die Jacke verschwindet, die Augenrichtung wird verändert, die Gesichter werden „Optimiert“ – und dann gesagt wird, man kann ja dann hinterher den Käse, den die KI gebaut hat, mit den eingebauten Tools wieder ausbügeln, dann bin ich halt am Zweifeln. Denn er zeigt nicht, wie das dann gemacht wird. Seine Endergebnisse sind nicht gut. Und das peinliche Gruppenbild am Haus zeigt er eben nur in Briefmarkengröße. Das muss man per Hand vergrößern, damit man sieht, was da alles schief gelaufen ist. Weil es eben nicht ein Problem der zu geringen Auflösung ist, wie er behauptet. Denn die Jacke war klar erkennbar da.